「コスト削減のために広告クリエイティブに生成AIを使いたいが、炎上が怖い」 「他社がなぜあんなに叩かれたのか、具体的な理由がわからず不安」

このような悩みを抱えているマーケティング担当者の方は多いのではないでしょうか。 2026年現在、生成AIの技術は飛躍的に向上しましたが、それに比例するように企業による活用時の「炎上」リスクも複雑化しています。かつてのような品質の問題だけでなく、「ブランドへの冒涜」「クリエイター軽視」といった倫理観や感情面での反発が主な火種となっているのが現状です。

この記事では、国内外の生成AI 炎上事例を分析します。そこから見えてくる「炎上の共通点」と「安全な活用ルール」を解説します。

消費者の感情に配慮した「賢いAI活用」のヒントをぜひ参考にしてください。

なぜ企業の「生成AI活用」は炎上するのか?3つの根本原因

多くの企業が陥りがちな誤解は、「法律(著作権)さえ守っていれば炎上しない」という思い込みです。しかし、実際の炎上事例を見てみると、法的な問題以前に「消費者の期待や感情」を裏切ったことによるケースが大半を占めています。 ここでは、企業が生成AIを利用する際に直面する3つの根本的な炎上原因を解説します。

【原因1】「手抜き・リスペクト不足」と受け取られる文脈

最も多いのが、ブランドがこれまで大切にしてきた価値観と、AI生成物の持つ「手軽さ」が衝突するパターンです。 例えば、職人の手仕事や温かみを売りにしているブランドが、プロモーション映像にAI生成画像を使用した場合、消費者は「自分たちの商品へのこだわりを捨てたのか」「クリエイティブを軽視している」と感じてしまう可能性があります。

これはコンテキスト(文脈)の不一致といえます。イラストレーター向けの商品を扱っている企業や、アニメ・漫画文化と親和性の高い企業が、人間のクリエイターを排除するかのようにAIを安易に使うと、「リスペクトがない」として猛烈な批判を浴びる可能性があります。

参考:ITmedia NEWS「ワコムの広告にAIイラスト? クリエイターから反発の声殺到 同社が経緯を説明する事態に」2024年1月10日

【原因2】AI生成画像特有の「違和感」

技術は進化しましたが、AI生成画像特有の「違和感」は依然としてリスク要因です。 一見綺麗に見えても、背景の文字が謎の言語になっていたり、人物の関節が不自然に曲がっていたりする画像は、見る人に嫌悪感を与えることがあります。 特に食品を扱う広告において、シズル感が重要なのに「プラスチックのような質感」の画像を使ってしまうと、食欲を減退させるだけでなく、「品質管理が甘い会社」というネガティブな印象に直結しかねません。

参考:東洋経済「マクドナルド「AI広告の炎上」が示す嫌悪感の正体」2024年8月20日

【原因3】最新リスク「NCII」と倫理的懸念

2025年末から2026年にかけて特に議論されているのが、AIによる非合意の性的画像(NCII)生成の問題です。 イーロン・マスク氏率いるxAIの「Grok」などが、ユーザーの投稿写真を容易に加工できてしまう機能を提供したことで、世界的な批判が集まりました。これにより、社会全体が「AI生成画像」に対して以前よりも厳しい視線を向けるようになっています。 「AIを使っている」というだけで、「倫理的に問題のある技術に加担している企業」と見なされるリスクさえ生まれており、企業はこれまで以上に慎重な姿勢が求められています。

参考:Ledge.ai「「写真が勝手にビキニ化」AI「Grok」画像編集が炎上」2026年1月5日

生成AIの炎上事例・失敗パターン分析

過去の事例を知ることは、未来の事故を防ぐために重要です。ここでは主要な生成AIの炎上事例と、対照的に好意的に受け入れられた成功事例を紹介します。

日本航空 (JAL):高級感を根底から損なった品質チェック不足

事象: 富裕層向け広告で、指や小物が物理的に崩壊したAI画像を使用し、批判を受け撤回しました。

要因: 「最高級(ラグジュアリー)」を謳いながら、粗雑なAI生成物をチェックなしで世に出したことで、ブランドへの信用が揺らいだことが要因と言えます。

出典:Yahoo!ニュース「JAL高級クレカ「違和感画像」問題 2回の差し替えに至った経緯とは」2025年8月

ワコム:クリエイター支援の理念との矛盾

事象: 「描く道具」のメーカーが公式SNSでAI画像を投稿し、主要顧客であるクリエイターから猛反発を受けました。

要因: 「人の創作を支える」という企業理念と、AIによる自動生成が矛盾しており、顧客に対する裏切り行為(アイデンティティの否定)と受け取られたことが要因と言えます。

出典:ITmedia NEWS「ワコムの広告にAIイラスト? クリエイターから反発の声殺到 同社が経緯を説明する事態に」2024年1月

サクラクレパス:画材メーカーとしての信頼を揺るがす「4本指」

事象: 画材メーカーが、指が4本の少女などのAI画像を展示し、専門性を疑われました。

要因: 「描くことのプロ」でありながら、素人でも気づくミスを見逃したことで、品質へのこだわりや絵画文化への敬意が欠如していると判断されたことが要因と言えます。

出典:ITmedia NEWS「サクラクレパス、“AI疑惑”のポスター撤去へ 「実際のデザインと相違」」2025年12月

神戸風月堂:ユーモアが裏目に出た「AI生成の粗雑さ」

事象: SNSのネタ投稿に低品質なAI画像を使用したところ、「不気味」「手抜き」と逆効果になりました。

要因: 親しみを醸成するための「ユーモア」が、AI特有の違和感(不気味の谷)によって阻害され、企業の「雑な姿勢」だけが強調されてしまったことが要因と言えます。

出典:アサミ経営法律事務所「JAL、神戸風月堂など、AIでの生成画像を使用した広告、SNS投稿が炎上。生成画像を使用する広報リスクをどう把握すべきか。」2025年8月

東洋水産:クリエイター軽視の疑念を招く「AIアニメーション」

事象: 動画広告に生成AI疑惑が浮上し、「クリエイター軽視のコストカット」として批判が集まりました。(なお、制作を手掛けたチョコレイトは生成AIを使用していないと否定の声明を出している。)

要因: 制作物から「人の手による熱量」が感じられず、効率化を優先してクリエイターを排除したというネガティブな文脈で解釈されたことが要因と言えます。

出典:ITmedia NEWS「炎上の「赤いきつねうどん」アニメCM、「生成AI使っていない」と制作元 「誹謗中傷・虚偽の拡散控えて」」2025年2月

車折神社:伝統的権威と機械的出力のミスマッチ

事象: 神社の公式画像をAIイラストに変更し、「有難みがない」と参拝者の感情を逆なでしました。

要因: 「精神性・伝統・祈り」という情緒的価値と、データ処理による「機械的な出力」の相性が極めて悪く、文脈のミスマッチが起きたことが要因と言えます。

出典:産経新聞「「全焼するぞ」…京都の芸能神社がXで大炎上 警察沙汰に発展した生成AIイラストの賛否」2025年7月

スシロー:権利関係の懸念を軽視した「大量連投」

事象: 公式SNSでAI画像を短期間に連投し、コンプライアンス意識やモラルを問う声が上がりました。

要因: 権利関係のリスクが残る技術を、質より量で安易に乱用した姿勢が、「知財や倫理への配慮不足」として不信感を招いたことが要因と言えます。

出典:BusinessJournal「スシロー、AIが生成した画像連投が物議…著作権法上、問題になる可能性も」2023年4月

比較検証:なぜ「伊藤園 お〜いお茶」は炎上せず成功したのか?

一方で、伊藤園の「お〜いお茶」のテレビCMにおけるAIタレント起用は、比較的ポジティブに受け入れられた事例として知られています。成功のポイントは以下の3点にあると考えられます。

- AIであることを隠さなかった:「AIタレントを起用」と明確にコンセプトを打ち出し、未来感を演出しました。

- 人間のプロによる大幅な修正:AIが出力したものをそのまま使うのではなく、デザイナーやアーティストの手で違和感のないレベルまで徹底的にクオリティを高めました。

- 既存タレントの代替ではない:「年齢を重ねない象徴的なキャラクター」としてAIを位置づけ、誰かの仕事を奪ったという印象を与えませんでした。

出典:日本経済新聞「日本経済新聞社 伊藤園、「お〜いお茶」CMに生成AIタレント」2023年10月

炎上リスクを最小化する「AI活用 3つ項目」

失敗事例と成功事例の差分から、企業が今すぐ取り入れるべき「安全なAI活用の項目」が見えてきます。

1.プロセスへの「人の介在」を必須にする

AIはあくまで「素材を作るツール」であり、「最終完成品を作る機械」ではありません。 出力されたテキストや画像をそのまま世に出すのではなく、必ず人間の担当者がファクトチェックを行い、デザイナーがレタッチを行う工程をワークフローに組み込むようにしましょう。 「AIで時短」を目指すあまり、チェック工程まで省略してしまうのが炎上の最短ルートです。

2.ブランドストーリーとの「整合性」を確認する

そのクリエイティブにAIを使うことが、自社のブランドメッセージと矛盾していないかを自問するようにしましょう。 「伝統」「手作り」「真心」といったキーワードを掲げる商品であれば、あえてAIを使わず、人間が制作したことをアピールする方がブランド価値は高まるかもしれません。逆に、先進的なテック企業や、スピード感を売りにするキャンペーンであれば、AI活用はプラスに働くかもしれません。 適材適所の判断こそが腕の見せ所です。

それに加えて、あえて「AI利用を公言する」ことも有効な手段です。 炎上の火種になりやすいのは、AIなのか人間なのかが曖昧な状態で世に出し、後から「実はAIだった」と特定されてしまうケースです。最初から堂々と活用を明記することで、企業の「透明性」や「誠実さ」が伝わり、不要な疑念による批判を避けることができます。

3.リスク発生時の「即応体制」と透明性

万が一、「AI生成物に問題がある」と指摘された場合の対応フローを決めておくことも重要です。 「AIが勝手にやった」という言い訳は通用しません。制作過程を説明できる透明性を確保し、不適切な点があれば素直に認めて修正する姿勢が、炎上の延焼防止に役立ちます。 社内でのリテラシー教育も不可欠です。現場の社員が「何が炎上リスクになるのか」を正しく理解できるような教育機会を設けることをお勧めします。

\DXアセスメント市場シェアNo.1/

「exaBase DXアセスメント&ラーニング」の資料請求はこちらから

注意すべき法的リスクと最新ガイドライン

感情的な反発リスクに加え、法的なリスクについても最低限の知識を押さえておく必要があります。2026年現在も、文化庁の見解が基本的な指針となっています。

著作権侵害と「類似性」・「依拠性」の判断

AI生成物が既存の著作権を侵害しているかどうかの判断には、「類似性」と「依拠性」の2点が重要になります。 特定の作家の画風を意図的に模倣させるプロンプト(「〇〇風」など)を使用した場合、依拠性が認められ、著作権侵害となるリスクが高まります。特定のクリエイターの作品のみを追加学習させる行為も、私的利用の範囲を超えて商用利用する場合は極めて慎重な判断が必要です。

情報漏洩リスクと入力データの管理

生成AIに自社の未公開製品情報や顧客データを入力してしまうと、そのデータがAIの学習に使用された場合、入力した機密情報が学習データの一部として取り込まれ、将来的に他のユーザーへの回答生成に間接的に影響を与える恐れがあります。 これを防ぐためには、契約内容で入力データが学習に利用されないことが定められていることを確認し、また入力データが学習に利用されない「オプトアウト設定」が可能なツールを選ぶ必要があります。

出典:文化庁「AIと著作権について」2024年

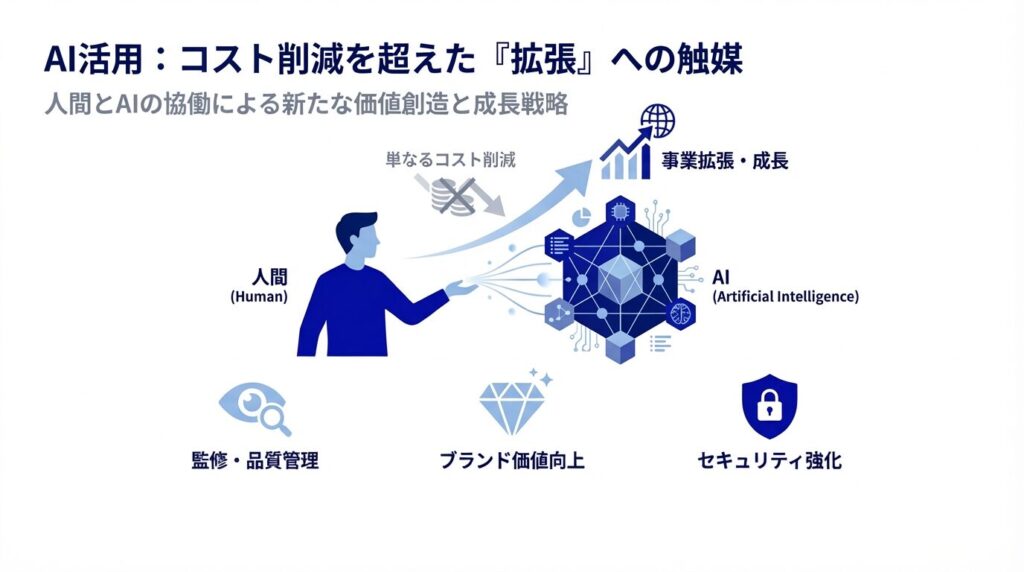

まとめ:AIは「コストカット」ではなく「拡張」のために使う

ここまで、生成AIの炎上事例とその対策について解説してきました。 炎上した事例に共通しているのは、「AIを使って手を抜こう」「開示しなければ問題ない」という、消費者に対する甘えや軽視の姿勢が透けて見えたときです。

逆に、AIを「人間のクリエイティビティを拡張するパートナー」として扱い、最終的な品質責任を人間がしっかり持っている企業は、炎上を回避し、成果を上げています。

- 人の目によるチェックと修正を徹底する

- ブランドの文脈に合わないAI利用は避ける

- セキュリティとリテラシー教育に投資する

これらを意識し、例えばexaBase 生成AIのようなセキュアな環境や、exaBase DXアセスメント&ラーニングによる組織的なリテラシー向上を組み合わせることで、リスクをコントロールしながらDXを推進していきましょう。